TEMAS-SUBTEMAS

Sentencia T-323/24

DERECHO AL DEBIDO PROCESO-Criterios orientadores para el adecuado uso de la inteligencia artificial (IA)

(...) criterios orientadores en cuanto al uso de herramientas de IA como ChatGPT por parte de los despachos judiciales en el país: a. Transparencia, entendida como la obligación de evidenciar con claridad y precisión el uso, alcances y ubicación en las actuaciones o decisiones de los resultados obtenidos por la utilización de tales herramientas, que permita a los usuarios e interesados su pleno conocimiento y la posibilidad efectiva de contradicción. B. Responsabilidad, comprendida como aquella obligación que existe de que el usuario de la herramienta de IA se encuentre capacitado y comprenda los impactos del uso de estas tecnologías, para a su vez dar cuenta del origen, idoneidad y necesidad del uso de la IA y la información suministrada por la misma, la cual debe ser verificada. c. Privacidad, es aquel deber de custodiar y proteger la reserva de los datos personales y sensibles que se ponen en conocimiento de la administración de justicia para cumplir con los fines propios de la Rama Judicial. d. No sustitución de la racionalidad humana, como expresión de la imposibilidad ética y jurídica de sustituir la acción y la responsabilidad del individuo de la especie humana en la gestión de las actuaciones y decisiones judiciales. e. Seriedad y verificación, que implica la obligación de realizar un estricto escrutinio sobre las fuentes, alcances, restricciones, posibilidades, falencias y riesgos que presente la herramienta de cara a la actuación en curso o a la solución del problema jurídico correspondiente. f. Prevención de riesgos, como mandato en cuanto aplicar los estándares adecuados de control sobre situaciones que generen riesgo por la aplicación de tecnologías tales, en aspectos como imprecisiones, desactualizaciones, alucinaciones, sesgos, inconsistencias y demás. g. Igualdad y equidad, en cuanto se erradiquen todas las formas de discriminación relacionadas con la aplicación de sesgos derivada del uso de tales tecnologías y su impacto negativo en la eficacia de los derechos humanos. h. Control humano, en tanto considerando los anteriores criterios, siempre se permita la realización efectiva de escrutinios sobre las actuaciones y decisiones en que se usen herramientas de IA, mediante el acceso a la debida información y el uso de recursos que deban ser resueltos por autoridades humanas. i. Regulación ética, que implica el desarrollo de estándares de comportamiento individual que se adecúen a los mandatos superiores y legales y a las pautas razonables para el uso de tales tecnologías por parte de los funcionarios y servidores de la Rama Judicial. j. Adecuación a buenas prácticas y estándares colectivos, en tanto se apliquen los esquemas razonables que se definan para el funcionamiento de la Rama Judicial, desde su autonomía e independencia, a partir de las definiciones que adopten sus autoridades, tanto en sede de administración como de orientación jurisprudencial. k. Seguimiento continuo y adaptación, a efecto que el uso de tales tecnologías consulte los avances jurídicos, sociológicos y tecnológicos que se vayan implementando, así como los esquemas de mejora y control que se construyan en forma progresiva. l. Idoneidad. El uso de las tecnologías de la información y de las comunicaciones en la gestión y trámite de los procesos judiciales y asuntos en curso debe ser adecuado para facilitar y agilizar el acceso a la justicia.

CARENCIA ACTUAL DE OBJETO-Reiteración de jurisprudencia

DERECHO AL DEBIDO PROCESO-Naturaleza, definición y garantías que lo conforman

SISTEMAS DE INTELIGENCIA ARTIFICIAL (IA)-Concepto y aspectos básicos acerca de su funcionamiento

SISTEMAS DE INTELIGENCIA ARTIFICIAL (IA)-Marco regulatorio

DERECHO AL DEBIDO PROCESO-Deberes del juez frente al uso de inteligencia artificial en una decisión judicial

El juez, cuando encuentre necesario y pertinente recurrir a sistemas de IA, puede emplearlos razonada y ponderadamente. Esto supone un enfoque de protección de derechos fundamentales, que valore y considere las mejores prácticas, así como la aplicación de criterios éticos y de respeto a los mandatos superiores. De acuerdo con ello, so pena de comprometer eventualmente su responsabilidad a raíz del uso indiscriminado e imprudente de estas tecnologías, el funcionario judicial que las emplee deberá respetar, como presupuesto mínimo en la materia, el criterio de no sustitución de la racionalidad humana, así como atender las cargas de transparencia, responsabilidad y privacidad. En virtud de aquel criterio, es factible emplear inteligencia artificial en labores propias de la justicia siempre que el uso de dichas herramientas no remplace labores jurisdiccionales indelegables e irremplazables, como lo son aquellas que requieren del razonamiento lógico y humano a efectos de interpretar los hechos, las pruebas, motivar la decisión o adoptarla.

DEBIDO PROCESO-Aplicación del principio del juez natural

DEBIDO PROCESO-Independencia e imparcialidad del juez

JUEZ-Obligación de motivar las decisiones

DEBIDO PROCESO PROBATORIO-Garantías mínimas

DERECHO A LA INTIMIDAD EN SISTEMAS DE INTELIGENCIA ARTIFICIAL (IA)-Alcance de la privacidad en el manejo de información

NIÑOS Y NIÑAS CON DISCAPACIDAD-Sujetos de especial protección constitucional

DERECHO A LA SALUD DE NIÑOS, NIÑAS Y ADOLESCENTES EN SITUACIÓN DE DISCAPACIDAD-Protección constitucional

PRINCIPIO DE CONTINUIDAD E INTEGRALIDAD EN EL SERVICIO PUBLICO DE SALUD-Prohibición de anteponer barreras administrativas para negar servicio

EXONERACION DE CUOTAS MODERADORAS Y COPAGOS-Reglas jurisprudenciales

DERECHO A LA SALUD DE NIÑOS Y NIÑAS EN SITUACION DE DISCAPACIDAD-Tratamiento integral

CUBRIMIENTO DE GASTOS DE TRANSPORTE PARA PACIENTE Y ACOMPAÑANTE POR EPS-Reglas jurisprudenciales

ACCESIBILIDAD AL DERECHO A LA SALUD-Transporte y copagos no puede ser obstáculo para acceder a los servicios de salud de quienes no tienen capacidad económica para asumirlos

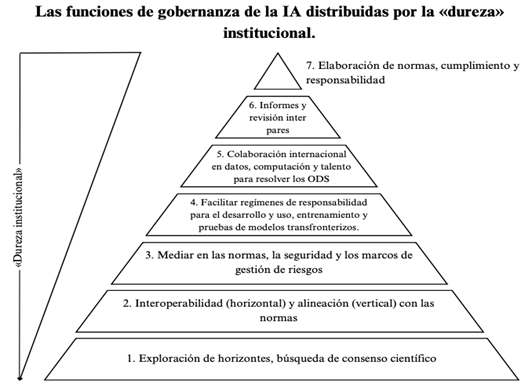

DERECHO AL DEBIDO PROCESO-Lineamientos sobre el uso de la inteligencia artificial (IA) en la Rama Judicial

DERECHO A LA SALUD DE NIÑOS, NIÑAS Y ADOLESCENTES EN SITUACIÓN DE DISCAPACIDAD-Orden a EPS abstenerse de realizar cobros, por concepto de copagos o cuotas moderadoras por la prestación de los servicios en salud que tenga que brindarle al menor

CUBRIMIENTO DE GASTOS DE TRANSPORTE PARA PACIENTE Y ACOMPAÑANTE POR EPS-Orden a EPS autorizar traslado de menor y acompañante, desde su lugar de residencia hasta el lugar en el que deba acceder al tratamiento, exámenes y citas médicas

EXHORTO-Funcionarios y empleados de la Rama Judicial

REPÚBLICA DE COLOMBIA

CORTE CONSTITUCIONAL

-Sala Segunda de Revisión-

SENTENCIA T-323 de 2024

Referencia: expediente T-9.301.656

Acción de tutela promovida por Blanca, en nombre y representación de su hijo menor de edad, en contra de la EPS

Asunto: uso de herramientas de inteligencia artificial generativas en procesos judiciales de tutela

Cobro de copagos y cuotas moderadoras en el SGSSS a niño diagnosticado con TEA

Magistrado sustanciador:

Juan Carlos Cortés González

SÍNTESIS DE LA DECISIÓN

Bogotá D.C., dos (02) de agosto de dos mil veinticuatro (2024)

La Sala Segunda de Revisión de la Corte Constitucional, integrada por la magistrada Diana Fajardo Rivera y los magistrados Vladimir Fernández Andrade y Juan Carlos Cortés González, quien la preside, en ejercicio de sus competencias constitucionales y legales, ha proferido la siguiente

SENTENCIA

1. En el trámite de revisión de los fallos (i) de segunda instancia dictado el 30 de enero de 2023 por el Juzgado del Circuito, que confirmó (ii) la decisión de primera instancia proferida por el Juzgado Municipal, el 7 de diciembre de 2022, dentro de la acción de tutela formulada por Blanca en contra de la EPS.

Aclaraciones previas. Reserva de la identidad

2. De conformidad con el artículo 62[1] del Reglamento Interno de la Corte Constitucional, las Salas de Revisión podrán disponer que en la publicación de la sentencia se omitan nombres o circunstancias que puedan identificar a las partes del proceso. En razón a que en el presente caso se hace referencia a las condiciones de salud de un niño, la Sala advierte que, como medida de protección de su intimidad, es necesario ordenar que se suprima de esta providencia y de toda futura publicación su nombre, así como cualquier otro dato o información que permita individualizarlo. En consecuencia, la Sala cambiará el nombre de las personas involucradas por ficticios, que se escribirán en cursivas.

3. Por tanto, en atención a lo dispuesto en el Acuerdo 02 de 2015[2] y la Circular Interna N.º 10 de 2022[3], esta providencia se registrará en dos archivos: uno con el nombre real de la actora y el representado, que la Secretaría General de la Corte Constitucional remitirá a las partes y autoridades involucradas. Otro con los nombres ficticios, que seguirá el canal previsto por esta corporación para la difusión de información pública.

I. ANTECEDENTES

Hechos

4. Blanca relató que su hijo menor de edad presenta un diagnóstico de trastorno de espectro autista (TEA). Por lo anterior, recibe terapias de rehabilitación en las áreas de psicología, terapia ocupacional y fonoaudiología.

5. El 31 de agosto de 2022, la tutelante radicó una petición ante la EPS, en la que solicitó que fuera exonerada del «pago de cuotas moderadoras de salud y copagos»[4], toda vez que, según afirmó, el artículo 12 de la Ley 1306 de 2009[5] y la Circular 016 de 2014 del Ministerio de Salud y Protección Social[6] exoneran a la población en situación de discapacidad del pago de cuotas moderadoras y copagos.

6. La entidad le indicó a la accionante las causales que hacían procedente la exoneración solicitada y expresó que, en caso de presentar alguna, debía acercarse para radicar la solicitud. Posteriormente, la accionante presentó la documentación requerida, sin embargo, según refirió, la EPS no adelantó las gestiones necesarias para reconocer el beneficio.

7. De forma adicional, Blanca le solicitó a la empresa promotora de salud (EPS) que asumiera los gastos de transporte para asistir a las terapias de su hijo, pues adujo no tener los recursos suficientes a efectos de sufragar los gastos asociados al desplazamiento suyo y del menor de edad. Manifestó que, aunque en ocasiones puede llevar al niño a pie, muchas otras veces, debido a la misma enfermedad de su hijo, este se rehúsa a caminar. Según informó la accionante, la EPS no emitió respuesta a esta solicitud.

8. La accionante indicó que no tiene un trabajo estable, es madre soltera y está clasificada en el grupo VI, subgrupo B1 del SISBEN (pobreza moderada). En consulta realizada por esta corporación, se encontró que la demandante está clasificada en el grupo A4 del SISBEN[7], correspondiente a pobreza extrema.

9. En virtud de lo anterior, Blanca interpuso una acción de tutela en contra de la EPS[8], por la presunta vulneración de los derechos a la salud y a la vida en condiciones dignas del menor de edad. Como pretensiones solicitó el amparo de estos derechos fundamentales y, en consecuencia, pidió se le ordene a la entidad (i) exonerar a su hijo de las cuotas moderadoras y copagos, (ii) cubrir los gastos de transporte, con el fin de que el niño pueda asistir a sus terapias, y (iii) garantizarle un tratamiento integral.

Actuaciones procesales en sede de tutela

10. En auto del 24 de noviembre de 2022, el Juzgado Municipal admitió la acción de tutela y corrió traslado a la EPS[9].

11. Respuesta de la EPS[10]. La entidad contestó que el menor de edad no pertenecía a la población objeto de especial atención referida en la Circular 0016 de 2014 del Ministerio de Salud y Protección Social y en la Ley 1306 de 2009, pues el diagnóstico «trastorno del espectro autista» no es propiamente una discapacidad mental/intelectual. Por ello no era procedente exonerarlo del pago de cuotas moderadoras y copagos por servicios autorizados por la EPS.

12. No obstante, explicó que, en ocasiones, ese diagnóstico podía asociarse a discapacidades del aprendizaje y, con base en ello, emitirse un certificado de discapacidad intelectual-mental. Para tales efectos era indispensable que un equipo interdisciplinario de especialistas evaluara varios factores, como el coeficiente intelectual, la capacidad de aprendizaje, la respuesta a los tratamientos de enfoque cognitivo conductual, entre otros.

13. En cuanto a la solicitud de gastos de transporte, señaló que la IPS CISADDE ofrece directamente ese servicio a los niños, niñas y adolescentes que reciben terapias en dicha entidad. La EPS manifestó que, con base en ello, se comunicó con la tutelante para informarle que se le había concedido el ingreso al programa de transporte. Con todo, la entidad aclaró que no existe orden médica alguna que respalde el derecho de la accionante a que dichos gastos sean cubiertos.

14. Finalmente, la accionada se opuso a que se ordene el suministro de tratamiento integral pues se afinca en una solicitud fundada en hechos futuros e inciertos que, por tanto, no puede llevar a la convicción sobre la transgresión de derechos fundamentales. Sobre el particular, agregó que, en la actualidad, no existe una orden médica vigente pendiente de autorizarle al menor de edad. Con base en lo anterior, solicitó declarar «improcedente» la acción de tutela al no existir una violación de los derechos del niño por parte de la EPS.

Sentencia de primera instancia[11]

15. El 7 de diciembre de 2022, el Juzgado Municipal amparó los derechos a la salud y a la vida en condiciones dignas del niño. En consecuencia, le ordenó a la EPS (i) autorizar el valor del transporte urbano o suministrar el servicio al menor de edad y a un acompañante, con el fin de asegurar su desplazamiento a la institución que corresponda, para recibir las terapias integrales prescritas por el médico tratante y (ii) asumir la prestación de los servicios de salud que en adelante requiera el menor de edad como consecuencia del diagnóstico «trastorno de espectro autista», sin exigencia de copagos o cuotas moderadoras, mientras subsista la insuficiencia de recursos económicos de sus padres para asumirlas[12].

16. Como fundamento de la decisión, sostuvo que, por tratarse de un menor de edad con un trastorno psicológico, se está en presencia de un sujeto de especial protección constitucional que requiere la garantía del acceso efectivo a los tratamientos prescritos por su médico. De acuerdo con ello, aunque al niño le fueron ordenadas ciertas terapias, su madre adujo no contar con suficientes recursos económicos para asistir al lugar donde debían practicarse, razón por la cual el juez consideró necesario acceder al amparo en lo que corresponde al transporte.

17. Frente a la solicitud de tratamiento integral, precisó que se requiere del diagnóstico que «el médico tratante estableció respecto al (sic) accionante y frente al cual recae la orden de tratamiento integral. Ello en consideración que no resulta posible dictar órdenes indeterminadas ni reconocer prestaciones futuras e inciertas; lo contrario implicaría presumir la mala fe de la EPS en relación con el cumplimiento de sus deberes»[13]. Al trasladar estas consideraciones al caso concreto, el juez no encontró prueba dentro del expediente en cuanto que el tratamiento integral hubiese sido ordenado por el médico tratante del menor de edad.

18. Respecto de la exoneración de cuotas moderadoras y copagos, el juez indicó que la tutelante realizó una negación indefinida sobre la carencia de recursos para asumir aquellos gastos, la cual no fue desvirtuada por la EPS. Por tanto, ordenó a la entidad exonerar a la tutelante de asumir dicha carga.

Impugnación[14]

19. La EPS reprodujo en la apelación los argumentos que expuso al momento de contestar la acción de tutela. Con base en ello, solicitó que se declarara su «improcedencia» por no existir vulneración de derechos y, con ello, que se revocara el fallo de primera instancia.

Sentencia de segunda instancia[15]

20. El 30 de enero de 2023, el Juzgado del Circuito resolvió confirmar la sentencia de primera instancia, al no encontrar que la EPS hubiera demostrado que la accionante contara con recursos económicos para sufragar los gastos asociados a la atención médica de su hijo. Así las cosas, señaló que, en el presente caso, las cuotas moderadoras y copagos representaban una barrera de acceso a los servicios de salud, por lo que corresponde al juez constitucional su eliminación.

21. De otro lado, «atendiendo que la Ley 2213 de 2022 tiene por objeto la incorporación de las TIC en los procesos judiciales», el juez advirtió que haría uso de herramientas de inteligencia artificial generativas (en adelante, IA) para «extender los argumentos de la decisión adoptada». Las preguntas realizadas al aplicativo y las respuestas emitidas por la herramienta ChatGPT 3.5, se transcriben a continuación:

¿Menor autista esta exonerado de pagar cuotas moderadoras en sus terapias?

La respuesta del aplicativo IA:

Sí, es correcto. De acuerdo con la normativa en Colombia, los menores con diagnóstico de autismo están exonerados de pagar cuotas moderadoras en sus terapias. Este beneficuento [sic] está regulado por la Ley 1753 de 2015 y se aplica a todas las instituciones prestadoras de servicios de salud públicas o privadas que reciban recursos del sistema general de seguridad social en salud.

¿Las acciones de tutela en estos casos se deben conceder?

La respuesta del aplicativo IA:

“En caso de que una institución prestadora de servicios de salud no cumpla con la exoneración de cuotas moderadoras para un menor con diagnóstico de autismo, la persona o sus representantes legales pueden presentar una acción de tutela para proteger sus derechos. La tutela es un mecanismo judicial rápido y eficaz para proteger derechos fundamentales que se ven vulnerados.

Si se demuestra que el derecho a la salud del menor con autismo está siendo afectado por la exigencia de pagar cuotas moderadoras, es probable que la acción de tutela sea concedida y se ordene a la institución prestadora de servicios de salud cumplir con la exoneración. Sin embargo, cada caso es único y la decisión final depende de los hechos y circunstancias específicas del caso.”.

¿Exigir en estos casos la cuota moderadora es una barrera de acceso al servicio de salud?

La respuesta del aplicativo IA:

“Sí, en algunos casos, la exigencia de pagar cuotas moderadoras puede ser una barrera de acceso al servicio de salud para personas con diagnóstico de autismo, especialmente si tienen dificultades para obtener ingresos o si su situación económica es precaria. La exigencia de pagar cuotas moderadoras puede impedir o dificultar el acceso a tratamientos y terapias esenciales para el bienestar y desarrollo de los niños con autismo.

Por esta razón, la normativa en Colombia exime a los menores con diagnóstico de autismo de pagar cuotas moderadoras en sus terapias, con el objetivo de garantizar el acceso a estos servicios de salud esenciales sin obstáculos financieros.”.

¿La jurisprudencia de la corte constitucional ha tomado decisiones favorables en casos similares?

La respuesta del aplicativo IA:

“Sí, es cierto. La Corte Constitucional de Colombia ha tomado decisiones favorables en casos similares relacionados con la exoneración de cuotas moderadoras para personas con diagnóstico de autismo. La jurisprudencia ha reconocido la importancia de garantizar el acceso a servicios de salud esenciales para las personas con autismo, y ha sostenido que la exigencia de pagar cuotas moderadoras puede ser una barrera de acceso a estos servicios. La jurisprudencia de la Corte Constitucional es una fuente importante para interpretar y aplicar la Constitución y las leyes en Colombia, y sus decisiones son vinculantes para todas las autoridades y entidades públicas del país. Por lo tanto, las decisiones favorables en casos similares pueden ser útiles como precedente para otros casos en los que se debata la exigencia de pagar cuotas moderadoras para personas con diagnóstico de autismo.”[16]

22. Sobre el uso de la IA explicó que su propósito no es reemplazar la decisión del juez, sino optimizar los tiempos empleados en la redacción de sentencias, previa corroboración de la información obtenida. Al respecto, en declaración[17] ante esta Corte, en el trámite de revisión, el juez insistió en que la decisión la tomó él, no la IA, la que consultó simplemente como una herramienta más de trabajo después de haber adoptado la determinación en el caso concreto. De acuerdo con ello, sostuvo que la consulta en ChatGPT fue solo un complemento de la decisión que ya había adoptado con base en los fundamentos clásicos de administración de justicia, basados en el razonamiento judicial.

Actuaciones en sede de revisión

23. Selección. El expediente fue enviado a la Corte Constitucional en cumplimiento de lo dispuesto en el artículo 32 del Decreto 2591 de 1991. En un principio, el estudio del caso para su eventual selección en sede de revisión le correspondió a la Sala de Selección Cuatro de 2023, la cual, mediante auto del 28 de abril de ese año, se abstuvo de hacerlo. No obstante, el expediente fue insistido por la magistrada Paola Andrea Meneses Mosquera, por el magistrado José Fernando Reyes Cuartas y por la Defensoría del Pueblo, bajo los siguientes argumentos:

24. Insistencia magistrada Paola Andrea Meneses Mosquera[18]. Expresó que el caso reflejaba debates novedosos para la Corte, particularmente, en lo que respecta a la falta de regulación en el uso de la IA en cuanto a la argumentación judicial, lo que plantea una serie de desafíos y consideraciones éticas y legales, como la transparencia, la protección de diversos derechos fundamentales involucrados y los mecanismos de control y supervisión adecuados. Consecuentemente, destacó que esta corporación tendría que definir las pautas sobre cómo se deben utilizar las tecnologías de IA en la toma de decisiones judiciales.

25. Insistencia magistrado José Fernando Reyes Cuartas[19]. Desarrolló algunos puntos contextuales sobre ChatGPT, la IA y su uso en otros países, para indicar que ni la legislación ni la jurisprudencia constitucional colombiana regulan el uso de las herramientas de la IA en el marco de la administración de justicia. De esta forma, precisó que el asunto es novedoso y su selección le permitiría a esta Corte determinar bajo qué parámetros es constitucional que los jueces puedan usar la plataforma ChatGPT u otro instrumento de IA para el cumplimiento de sus funciones.

26. Insistencia de la Defensoría del Pueblo[20]. Manifestó que, si bien la utilización de las Tecnologías de la Información y las Comunicaciones (TIC) están llamadas a apoyar y ayudar a los operadores judiciales en la toma de decisiones, la utilización específica de la IA debe ser objeto de límites y controles. Así, destacó que, aunque existe normativa en el ordenamiento jurídico colombiano que busca por medio de las tecnologías facilitar el acceso a la administración de justicia, se podría estar ante la eventual vulneración del derecho al debido proceso, pues el uso de estas herramientas en el sector justicia exige un máximo de cuidado y control. Por tanto, solicitó a esta Corte pronunciarse sobre el tema, con el fin de que se establezcan las definiciones, límites y controles necesarios conforme a la Constitución Política.

27. La Sala de Selección de Tutelas Número Seis de la Corte Constitucional seleccionó el asunto para revisión por cumplir con los criterios objetivos referentes a «asunto novedoso» y «exigencia de aclarar el contenido y alcance de un derecho fundamental». El auto respectivo fue notificado el 17 de junio de 2023 y la Secretaría General remitió el expediente al despacho del magistrado sustanciador para lo de su competencia.

28. Primer auto de pruebas. Mediante auto del 22 de agosto de 2023[21], el magistrado sustanciador decretó pruebas de oficio. En particular, (i) indagó sobre las condiciones del menor de edad y si estaba recibiendo servicios de salud sin pagos por cuotas moderadoras o copagos; (ii) ordenó tomar la declaración del Juez del Circuito, para que respondiera interrogantes relacionados con el uso que le dio a la herramienta ChatGPT para sustanciar la sentencia que profirió el 30 de enero de 2023; (iii) acudió ante entidades del Estado y colegios de jueces y fiscales del país, con el fin de esclarecer si existían protocolos, lineamientos o guías para el uso de herramientas de inteligencia artificial generativas en el país; (iv) solicitó el concepto de abogados, doctrinantes y organizaciones civiles expertos en la influencia de las tecnologías de la información en la aplicación del derecho, sobre las implicaciones de utilizar estas herramientas en la sustentación de decisiones judiciales y si conocían de regulaciones nacionales o internacionales al respecto; y (v) le preguntó a ciertas facultades de ingeniería de universidades del país sobre las condiciones y limitaciones técnicas que podían tener las herramientas de inteligencia artificial generativas y su incidencia en la sustentación de decisiones judiciales.

29. Segundo auto de pruebas. El 13 de diciembre de 2023, la Sala Segunda de Revisión emitió un segundo auto de pruebas y suspendió los términos por tres meses, con el fin de decretar y practicar pruebas adicionales, en atención a la complejidad del asunto. En concreto, la Sala formuló preguntas adicionales relacionadas con (i) las potencialidades del uso de herramientas de IA en las labores judiciales; (ii) los riesgos de su uso y la forma en que se pueden contrarrestar; (iii) las características de las herramientas de IA que existen hoy en día y la posibilidad de usarlas para apoyar labores judiciales: lo anterior, sin poner en riesgo derechos y principios y procurando aportar para hacer más efectiva la administración de justicia; y (iv) los aspectos técnicos, operativos y económicos que deben tenerse en cuenta para implementar el uso de las herramientas de inteligencia artificial generativa en la Rama Judicial.

30. Las respuestas a dichos autos de pruebas se encuentran en los anexos 2, 3 y 4 de la presente providencia. Las entidades y personas que participaron se relacionan a continuación: Facultad de Ingeniería, Escuela de Gobierno y Facultad de Derecho de la Universidad de los Andes; Facultad de Ingeniería de la Universidad de la Sabana; Mujeres TIC; Ministerio de las Tecnologías de la Información y las Comunicaciones; Consejo Superior de la Judicatura; Asociación Colegio de Jueces y Fiscales de Cali; Fundación Karisma; Grupo El Veinte; Open AI; Grupo de Estudios en Internet, Comercio Electrónico, Telecomunicaciones e informática de la Universidad de los Andes; Juez del Circuito; Blanca, como representante legal de su hijo; Colegio de Jueces y Fiscales de Antioquia; Agneris Sampieri; Asociación Colombiana de Mujeres; Erick Rincón Cárdenas de la Universidad del Rosario; Escuela Judicial Rodrigo Lara Bonilla; el Centro de Internet y Sociedad de la Universidad del Rosario; el Congreso de la República de Colombia; Lorena Flórez Rojas y Juan David Gutiérrez Rodríguez. De manera adicional, en el anexo 1 se incluye la intervención de Daniel Cortés, quien actuó como coadyuvante de la parte demandante, al igual que las intervenciones de Link TIC S.A.S., Pilar Ibáñez y Pedro Nel Rueda Garcés quienes, de manera voluntaria, remitieron sus conceptos a esta Corte. En los respectivos anexos se encuentra una síntesis de cada pronunciamiento, que por su extensión no es incluida en la sentencia.

31. Tercer auto de pruebas. El 28 de febrero de 2024, se ordenó el uso, por parte del despacho sustanciador, de la herramienta de inteligencia artificial ChatGPT, que empleó el Juez del Circuito, a efectos de confrontar los interrogantes que realizó dicho funcionario y el alcance de las conclusiones obtenidas. La diligencia se llevó a cabo el 8 de marzo de 2024[22] y sus resultados se encuentran contenidos en el anexo 5.

II. CONSIDERACIONES

Competencia

32. Con fundamento en los artículos 86 y 241.9 de la Constitución y 31 a 36 del Decreto 2591 de 1991, la Sala Segunda de Revisión de Tutelas de la Corte Constitucional es competente para revisar los fallos de tutela proferidos en el proceso de la referencia.

Examen de procedencia de la acción de tutela

33. La acción de tutela es un mecanismo de defensa judicial que permite la protección inmediata de los derechos fundamentales de una persona, cuando estos resulten comprometidos por la acción u omisión de autoridades públicas o particulares. No obstante, pese a la informalidad que se predica de este mecanismo, su procedencia está sometida al cumplimiento de los requisitos de legitimación, inmediatez y subsidiariedad.

34. Legitimación. Se refiere, en esencia, al interés que ostentan quienes intervienen en el trámite constitucional, bien porque son titulares de los derechos cuya protección o restablecimiento se discute (activa) o porque tienen la capacidad legal de responder por la vulneración o amenaza alegada (pasiva).

35. Legitimación por activa. El artículo 86[23] de la Constitución Política establece la facultad que tiene toda persona para interponer la tutela por sí misma o por quien actúe a su nombre, con el fin de reclamar ante los jueces la protección inmediata de sus derechos constitucionales fundamentales, cuando quiera que estos resulten vulnerados o amenazados. La legitimación para interponer la acción de tutela se encuentra regulada en el artículo 10[24] del Decreto 2591 de 1991, según el cual esta puede presentarse: (i) directamente por el afectado, (ii) a través de su representante legal, (iii) por medio de apoderado judicial o (iv) por un agente oficioso[25]. El inciso final de este artículo también faculta al defensor del pueblo y a los personeros municipales para interponer la acción de tutela directamente.

36. En el presente caso, este requisito se encuentra acreditado debido a que la tutela fue interpuesta por Blanca, madre del niño Emilio, quien actuó como representante legal de su hijo con el fin de invocar la protección de sus derechos fundamentales al debido proceso, a la vida, a la salud y a la seguridad social. En el caso en concreto, es claro que el niño, quien ha sido diagnosticado con TEA, no puede acudir a la defensa directa de sus derechos.

37. Legitimación por pasiva. La jurisprudencia constitucional ha establecido que la legitimación por pasiva en la acción de tutela hace referencia a la aptitud legal de la entidad o de los particulares contra quienes se dirige la acción, de ser los llamados a responder por la vulneración o amenaza de derechos fundamentales, en caso de que la transgresión resulte probada[26]. De acuerdo con el artículo 86 superior, la legitimación por pasiva exige acreditar dos requisitos: (i) que la acción se dirige contra autoridades o particulares que presten un servicio público o cuya conducta afecte grave y directamente el interés colectivo o respecto de los cuales el solicitante se halle en estado de subordinación o indefensión y (ii) que la conducta que genera la vulneración o amenaza del derecho se pueda vincular, directa o indirectamente, con su acción u omisión.

38. En este proceso, la acción se presenta en contra de un particular que presta un servicio público. De acuerdo con el artículo 42.2 del Decreto Legislativo 2591 de 1991[27], la acción de tutela procede en contra de acciones u omisiones de particulares que estén encargados de la prestación del servicio público de salud. En este caso, la accionada es la EPS, entidad promotora de salud a la cual se le atribuye la violación de los derechos fundamentales del niño Emilio. Así las cosas, se encuentra acreditado este requisito.

39. Inmediatez. La jurisprudencia constitucional ha resaltado que, de conformidad con el artículo 86 de la Constitución, la acción de tutela no tiene término de caducidad. Sin embargo, esta debe formularse en un plazo razonable desde el momento en el que se produjo el hecho vulnerador. Este requisito responde al propósito de protección inmediata de los derechos fundamentales, lo que implica que, pese a no existir un término específico para acudir ante el juez constitucional, las personas deben actuar diligentemente y presentar la acción de tutela en un tiempo razonable. El juez evaluará las circunstancias de cada caso para determinar si el recurso fue presentado oportunamente, flexibilizando su análisis ante la concurrencia de sujetos de especial protección constitucional o personas en condición de vulnerabilidad[28]. El requisito de inmediatez debe evaluarse en cada caso concreto, de conformidad con los principios de razonabilidad y proporcionalidad[29].

40. En circunstancias excepcionales, el juez de tutela puede concluir que resulta procedente una solicitud de amparo presentada después de transcurrido un tiempo considerable desde el momento en que se vulneró o amenazó un derecho fundamental. Dichas circunstancias son las siguientes: (i) cuando se advierten razones válidas para la inacción del actor, tales como la configuración de situaciones de caso fortuito o fuerza mayor; (ii) en los casos en los que la situación de debilidad manifiesta del peticionario torna desproporcionada la exigencia del plazo razonable y (iii) excepcionalmente, cuando se presenta una situación de permanencia o prolongación en el tiempo de la vulneración o amenaza de los derechos fundamentales que hace imperiosa la intervención del juez constitucional[30].

41. En el presente asunto, el 31 de agosto de 2022, la tutelante radicó una petición ante la entidad accionada, en la que solicitó ser exonerada del pago de cuotas moderadoras de salud y copagos. La EPS contestó[31] que debía acercarse ante la entidad con la documentación necesaria. La accionante la presentó, pero, según indicó, la EPS no adelantó las gestiones correspondientes. El 13 de diciembre de aquel año[32], la tutelante interpuso acción constitucional. Esto es, tres meses y medio después de haber radicado la solicitud. Este es un lapso razonable para instaurar la acción de amparo. Por tanto, se acredita este presupuesto.

42. Subsidiariedad. El inciso 4.º del artículo 86 de la Constitución consagra el principio de subsidiariedad como requisito de procedencia de la acción de tutela y determina que «[e]sta acción sólo procederá cuando el afectado no disponga de otro medio de defensa judicial, salvo que aquella se utilice como mecanismo transitorio para evitar un perjuicio irremediable». Es decir que, si existen otros mecanismos de defensa judicial que resultan idóneos y eficaces para solicitar la protección de los derechos que se consideran amenazados o vulnerados, se debe acudir a ellos y no a la tutela.

43. Sobre el particular, la Corte Constitucional ha determinado que cuando una persona acude ante el juez de tutela con el fin de que le sean protegidos sus derechos, no puede desconocer las acciones judiciales contempladas en el ordenamiento jurídico, ni pretender que se adopten decisiones paralelas a las del funcionario que debe conocer un determinado asunto radicado bajo su competencia, dentro del marco estructural de la administración de justicia[33].

44. Sin embargo, aun cuando existan mecanismos dispuestos en el ordenamiento para la satisfacción de los derechos fundamentales presuntamente vulnerados, en virtud de lo dispuesto en los artículos 86 superior y 6.º del Decreto 2591 de 1991, la tutela es procedente si se acredita (i) que el mecanismo principal no es idóneo ni eficaz o (ii) que a pesar de ser apto, no es lo suficientemente expedito para evitar que se configure un perjuicio irremediable.

45. El primer escenario descrito se refiere a la idoneidad del medio de defensa judicial. Tal análisis, según la jurisprudencia de esta corporación, no puede hacerse en abstracto, sino que depende del caso concreto, para lo cual deben tomarse en cuenta las características procesales del mecanismo y el derecho fundamental involucrado. Así, el mecanismo principal excluye la procedencia de la acción de tutela cuando salvaguarda de manera eficaz el derecho respecto del cual se solicita el amparo[34].

46. El segundo escenario se refiere a la interposición de la acción de tutela como mecanismo transitorio. La Corte Constitucional ha establecido que, en este caso, debido a que existe un medio judicial principal, se debe demostrar que la intervención del juez constitucional es necesaria para evitar la ocurrencia de un perjuicio irremediable. Sobre la naturaleza de tal perjuicio, la jurisprudencia ha señalado:

(i) debe ser inminente, es decir, que se trate de una amenaza que está por suceder prontamente; (ii) debe ser grave, esto es, que el daño o menoscabo material o moral en el haber jurídico de la persona sea de gran intensidad; (iii) las medidas que se requieren para conjurar el perjuicio irremediable deben ser urgentes; y (iv) la acción de tutela debe ser impostergable a fin de garantizar que sea adecuada para restablecer el orden social justo en toda su integridad[35]

47. De este modo, cuando exista otro medio de defensa judicial para salvaguardar los derechos reclamados, el juez constitucional deberá evaluar si este es idóneo y eficaz para resolver el problema jurídico objeto de estudio. Asimismo, cuando exista un mecanismo idóneo, deberá verificar si en el caso particular la tutela es procedente excepcionalmente para evitar la ocurrencia de un perjuicio irremediable. Por tanto, si existe un mecanismo principal, la acción de tutela será procedente solamente cuando se configure alguna de las dos hipótesis mencionadas.

48. Esta corporación ha afirmado que el artículo 41 de la Ley 1122 de 2007 asigna a la Superintendencia Nacional de Salud funciones jurisdiccionales para conocer controversias relacionadas con la cobertura de servicios, tecnologías o procedimientos de salud incluidos en el PBS. Sin embargo, en reiterada jurisprudencia, ha determinado que dicho mecanismo no es eficaz para la protección de los derechos fundamentales de los usuarios, pues «presenta deficiencias normativas y estructurales que mientras no se solventen, impiden considerarlo como eficaz para la efectiva protección del derecho a la salud»[36]. En todo caso, aún en el evento en que tales dificultades se superen, dicho medio de defensa no desplaza por completo a la acción de tutela. En cada caso particular debe evaluarse: «a) si la función jurisdiccional es idónea y eficaz; b) si el asunto versa sobre la negativa o la omisión en prestación de servicios y tecnologías en salud y c) la posible afectación de los derechos fundamentales de un sujeto de especial protección, como los niños y los adultos mayores»[37].

49. En el presente asunto, la accionante acude a la acción de tutela para que la exoneren de los copagos y cuotas moderadoras en salud en los que debe incurrir para que su hijo reciba terapias de rehabilitación en las áreas de psicología, terapia ocupacional y fonoaudiología. Además, solicita que le sean cubiertos los gastos de transporte. Lo anterior, en tanto afirma que no tiene los recursos económicos para asumir aquellos gastos. Al respecto, la Sala encuentra que la accionante está clasificada en el grupo A4 del SISBEN[38], es decir, en pobreza extrema y, aunque registra afiliación en el régimen contributivo de salud[39], lo está en calidad de beneficiaria. En esa medida, ciertamente, la accionante tiene escasos recursos económicos, lo cual puede afectar el acceso a los servicios de salud que requiere su hijo, quien es sujeto de especial protección constitucional.

50. En síntesis, la Sala encuentra que la acción de tutela presentada por Blanca satisface los requisitos generales de procedibilidad.

Carencia actual de objeto. Reiteración de jurisprudencia

51. La jurisprudencia constitucional[40] ha determinado que la carencia actual de objeto sucede cuando la acción de tutela ha perdido su razón de ser, ya sea por un hecho superado, por un daño consumado o por una situación sobreviniente[41]. Se trata de una figura procesal por medio de la cual el juez constitucional debe constatar si, en efecto, la situación que motivó la solicitud de amparo se encuentra superada.

52. En la Sentencia SU-522 de 2019 la Sala Plena de la Corte hizo un balance de la jurisprudencia constitucional en la materia y explicó las hipótesis que la configuran. Respecto del hecho superado reiteró que corresponde a la satisfacción de lo pretendido en la acción de tutela por parte de la entidad accionada. En estos casos, el juez debe comprobar si (i) lo pedido mediante acción de tutela ha sido satisfecho de manera integral y (ii) si la entidad demandada actuó o cesó en su accionar, según corresponda, de manera voluntaria.

53. Por su parte, el daño consumado se presenta cuando no es posible proteger el derecho fundamental, debido a que la afectación que se pretendía evitar se materializó[42].

54. En cuanto a la circunstancia o el hecho sobreviniente, en el fallo aludido, la Corte señaló que «remite a cualquier “otra circunstancia que determine que, igualmente, la orden del juez de tutela relativa a lo solicitado en la demanda de amparo no surta ningún efecto y por lo tanto caiga en el vacío”. No se trata entonces de una categoría homogénea y completamente delimitada»[43]. En ese sentido, se puede entender que el hecho sobreviniente tiene un carácter residual, es decir, se configura cuando la circunstancia estudiada no encuadra dentro de alguno de los dos conceptos tradicionales (hecho superado y daño consumado) en materia de carencia actual de objeto.

55. Así, lo que diferencia a la circunstancia sobreviniente del hecho superado es que en la primera situación el objeto de la tutela pierde su razón de ser por un hecho ajeno a la parte accionada –bien sea, por ejemplo, por la actuación de un tercero, del mismo accionante o porque este ha perdido interés en la satisfacción de su pretensión–, mientras que el hecho superado se configura cuando el extremo demandado ha satisfecho, por iniciativa propia, el objeto de la acción de tutela.

56. Respecto del deber del juez de tutela en los casos en que se configura un hecho superado o una situación sobreviniente, esta Corte ha unificado su jurisprudencia para sostener que, aunque no es imperioso que este profiera una decisión de fondo, puede emitir un pronunciamiento en ese sentido cuando lo considere necesario para «a) llamar la atención sobre la falta de conformidad constitucional de la situación que originó la tutela y tomar medidas para que los hechos vulneradores no se repitan; b) advertir la inconveniencia de su repetición, so pena de las sanciones pertinentes; c) corregir las decisiones judiciales de instancia; o d) avanzar en la comprensión de un derecho fundamental»[44].

57. Con base en estas consideraciones, la Sala de Revisión procede a analizar si en el caso sometido a estudio se configuró una carencia actual de objeto. En el informe que se le solicitó rendir a Blanca en el presente trámite de revisión, esta afirmó que la EPS ha respondido directa y diligentemente a las solicitudes que realizó en la demanda de tutela y ha hecho un seguimiento continuo del caso a través de llamadas de supervisión con el fin de estar enterada de los pormenores que han ido surgiendo desde la presentación del escrito de tutela[45]. No obstante, realizó la siguiente precisión:

[M]e encuentro exonerada del pago de cuotas moderadoras de salud y copagos para los servicios de salud de mi hijo Emilio, pero el niño requiere una serie de estudios cada 3 meses con el médico neurólogo, con el psiquiatra y genetista, además se le practican resonancias, estudios genéticos, electrocardiogramas, encefalogramas, evocados auditivos, sin embargo, al momento de acudir a las entidades que prestan los servicios, estas nos solicitan el pago de cuotas moderadoras de salud y copago, de manera que me toca expresar que mi hijo se encuentra exonerado de este copago, a lo que las entidades manifiestan que estos son temas que deben manejarse directamente con la EPS, situación que hace que debe dirigirme a la EPS para exponerles la situación, los cuales de manera diligente gestionan el cumplimiento de esta exoneración[46].

58. Y, en cuanto al servicio de transporte, sostuvo:

[N]o me toca pagar viáticos para dirigirme a los controles terapéuticos, mientras que para cuestiones de inspección con especialistas, en los casos de neurólogo, psiquiatra, genetista, y para los procesos de resonancias, estudios genéticos, electrocardiogramas, encefalogramas y evocados auditivos, sí es necesario que haga uso de mis recursos económicos para el pago de los viáticos para dirigirme a los lugares donde el niño Emilio recibe los servicios de salud[47]

59. Visto lo anterior, en lo que se refiere al suministro directo o pago de gastos de transporte para la atención médica del niño, es claro que no se configura un hecho superado debido a que la EPS accionada únicamente ha satisfecho la pretensión respecto de los trayectos requeridos para las terapias que le son prescritas al niño, no así para el desplazamiento a citas con las diferentes especialidades médicas que lo atienden y las ayudas diagnósticas que se le ordenan.

60. La Sala tampoco advierte un hecho superado en relación con las transgresiones alegadas por el cobro de copagos y cuotas moderadoras que genera la atención médica y asistencial del niño. Si bien la accionante admitió que en la actualidad se encuentra exonerada de tales pagos, también manifestó que la efectividad de tal medida se ve reducida por la falta de comunicación entre la EPS accionada y las IPS encargadas del suministro de la atención médico asistencial del menor que, en muchas ocasiones, al no tener conocimiento de la medida de exoneración, generan el cobro de copagos y cuotas moderadoras, lo que se traduce en cargas administrativas para que la accionante gestione entre ambas entidades el reconocimiento de la exoneración, lo que de ser así alteraría el respeto por los principios de accesibilidad e integralidad del SGSSS, con la consecuente afectación del derecho a la salud del menor de edad.

61. Por último, tampoco se estructura una carencia actual de objeto por un hecho superado, respecto al tratamiento integral, toda vez que persiste la duda de que se haya garantizado la continuidad en la prestación del servicio de salud en su totalidad. Al ser el agenciado un sujeto de especial protección constitucional, es importante para esta Sala revisar el asunto.

62. Establecido que se cumplen los requisitos de procedibilidad y que no se ha configurado una carencia actual de objeto, se procede al análisis de fondo de la actuación.

Problema jurídico y metodología de la decisión

63. La Sala deberá revisar dos aspectos de la actuación. Por una parte, verificará la posible vulneración del derecho fundamental al debido proceso en cuanto la decisión de segunda instancia proferida en este radicado, ya que, en ella, para resolverla, el juez hizo uso de IA, en específico, de ChatGPT 3.5; por otra, estudiará si se lesionó el derecho a la salud del niño Emilio, al no ser exonerado de los cobros de copagos y cuotas moderadoras en el SGSSS, al no suministrarle el servicio de transporte integralmente y al negársele el derecho a un tratamiento integral.

- Sobre la violación al debido proceso

64. En cuanto a la primera cuestión se tiene que, el Juzgado del Circuito, actuando en calidad de juez de tutela de segunda instancia en la actuación de la referencia, hizo uso de una herramienta de IA generativa, en específico de ChatGPT 3.5, para elevar consultas jurídicas relacionadas con la materia puesta a su conocimiento. En concreto, gestionó algunas preguntas en el aplicativo y copió las respuestas obtenidas en la sentencia.

65. El anterior proceder genera dudas respecto a (i) si quien emitió la decisión fue un juez de la República o una IA y (ii) si la decisión fue debidamente motivada o fue producto de respuestas o alucinaciones generadas por la IA.

66. Los anteriores interrogantes llevan a plantear si el uso de IA a través de la herramienta ChatGPT 3.5 que se hizo en la toma de la decisión de segunda instancia, para formular consultas e incorporar sus respuestas en el fallo, conlleva una violación al debido proceso y, de ser así, a la invalidez de la actuación a partir de dicho pronunciamiento.

67. Esta Sala considera pertinente reiterar que, como juez de tutela, se encuentra facultada para revisar toda la actuación de tutela, para determinar si se evidencia o no la vulneración de derechos fundamentales, entre ellos el del debido proceso, de tal suerte que esta función no está condicionada a lo que se invoque por los intervinientes dentro del trámite de revisión[48]. En efecto, en su rol de garante de la integridad del ordenamiento jurídico y por mandato del artículo 29 superior, a la Corte Constitucional le corresponde velar por el respeto del debido proceso en todas las actuaciones judiciales a su cargo. De acuerdo con ello, la corporación ha sostenido que:

Ante una vulneración “ostensible, probada, significativa y trascendental” del debido proceso, que tenga repercusiones sustanciales en la decisión, corresponde a la Corte, en concordancia con el artículo 29 superior, garantizar este derecho en todas las actuaciones ante ella surtidas, y observar que se respeten los procedimientos previstos en los Decretos 2067 y 2591 de 1991, así como en el Reglamento interno[49]

68. En conclusión, esta Corte tiene la facultad de realizar un estudio de validez, bien sea oficioso o rogado, tanto del procedimiento y de las actuaciones surtidas en el proceso de tutela ante las instancias, como de sus propias determinaciones en sede del trámite de revisión de los fallos allí proferidos. Este análisis puede implicar que se concluya la necesidad de decretar la nulidad de lo actuado o de aplicar mecanismos de subsanación, por lo cual puede realizarse, incluso, en forma previa a la revisión de fondo en el caso. En el presente trámite, la Sala abordará el asunto como cuestión de fondo pues se trata de definir, por primera vez, elementos que precisen el alcance del derecho al debido proceso frente al uso razonado de herramientas derivadas de la IA en el trámite de acciones de tutela. En ese sentido, se trata de una decisión innovadora que introduce parámetros de comportamiento judicial nunca antes abordados por la Corte Constitucional, lo que implica que el fallo tiene la potencialidad de generar un impacto social y jurídico significativo con efectos que trascienden el caso concreto. La relevancia particular que puede tener un asunto con estas características para el interés público y el orden constitucional, además de las órdenes que deberán impartirse al respecto, con efectos inter comunis, como se explicará en su momento, justifican un examen exhaustivo del uso de la IA en las decisiones judiciales que, en esta oportunidad, debe efectuarse mediante un estudio de fondo, sin perjuicio de que, en futuras ocasiones, se pueda acudir a otras metodologías atendiendo a las particularidades del caso.

69. Visto lo anterior, la Sala de Revisión considera que en el presente caso procede realizar un estudio oficioso acerca de la validez de las actuaciones adelantadas por el juez de tutela en segunda instancia, específicamente, del fallo que emitió el 30 de enero de 2023, a efectos de establecer si en él se incurrió en alguna irregularidad que implique una violación del derecho al debido proceso. Con tal fin, responderá el siguiente interrogante:

¿La sentencia de tutela del 30 de enero de 2023, que es objeto de revisión por esta Corte, incurrió en una violación del derecho al debido proceso, en específico, al quebrantar las garantías del juez natural y al motivar indebidamente la decisión, por incorporar las respuestas que arrojó un sistema de IA generativo, ChatGPT 3.5, consultado por el juez competente para proferir la decisión?

70. Para responder esta pregunta, se abordarán los siguientes temas (i) el derecho fundamental al debido proceso; (ii) el debido proceso en un sistema jurisdiccional que utiliza IA; (iii) el sistema de IA. Conceptos y aspectos básicos acerca de su funcionamiento; (iv) impactos del uso de herramientas de IA en la sociedad; (v) el estado de la IA en Colombia, (vi) el marco regulatorio de la IA en el mundo. Algunos instrumentos de soft law e iniciativas normativas nacionales; (vii) algunas experiencias relacionadas con la IA en la práctica judicial; (viii) la garantía del juez natural en un sistema jurisdiccional que utiliza IA; (ix) el debido proceso probatorio en un sistema jurisdiccional que utiliza IA y (x) conclusiones.

- La exoneración de cobros de copagos y cuotas moderadoras en el SGSSS, el suministro del servicio de transporte y el derecho a un tratamiento integral para niños con funcionalidad diversa

71. Respecto a este punto, se pudo constatar que Blanca interpuso una acción de tutela en contra de la EPS. A juicio de la accionante, su hijo tiene derecho a ser exonerado del pago de copagos y cuotas moderadoras en salud. Asimismo, solicitó que los gastos de transporte fueran cubiertos y se le garantizara al niño un tratamiento integral. Los jueces de instancia ordenaron a la entidad accionada cubrir los gastos de transporte en los que incurría la accionante para llevar a su hijo a las terapias y exonerar a este último de copagos y cuotas moderadoras en salud.

72. La Sala de Revisión se pronunciará sobre el debate constitucional derivado del siguiente problema jurídico:

¿Una EPS vulnera los derechos fundamentales a la salud, la vida digna y la seguridad social de un niño diagnosticado con trastorno de espectro autista (i) al no exonerarlo de copagos y cuotas moderadoras; (ii) al no suministrarle el servicio de transporte interurbano bajo el argumento de que no existe prescripción médica que lo ordene pese a que su familia cuenta con escasos recursos para cubrirlo y (iii) al no autorizarle un tratamiento integral?

73. Con el propósito de resolver estos interrogantes, la Sala abordará los siguientes temas: (i) los niños, niñas y adolescentes como sujetos de especial protección constitucional; (ii) las personas en situación de discapacidad como sujetos de especial protección constitucional; (iii) el derecho a la salud; (iv) los niños, niñas y adolescentes en situación de discapacidad y la protección de su derecho fundamental a la salud; (v) la prohibición de anteponer barreras administrativas para la prestación del servicio de salud; (vi) tratamiento integral; (vii) reconocimiento de los gastos de transporte para el paciente y un acompañante y (viii) cobros en el sistema de seguridad social en salud. Exoneración de copagos y cuotas moderadoras para personas en situación de discapacidad física o cognitiva. (ix) Finalmente se resolverán los dos aspectos planteados.

Uso de la herramienta de inteligencia artificial IA generativa ChatGPT en procesos de tutela y debido proceso

(i) El derecho fundamental al debido proceso

74. El artículo 29 de la Constitución Política consagra el derecho fundamental del debido proceso, el cual a su vez está conformado por una serie de garantías aplicables a todo tipo de procedimientos. Desde este punto de vista, las normas procesales que se refieren a los derechos fundamentales que conforman el debido proceso no pueden ser tenidas como normas adjetivas, sino que ellas son normas sustanciales.

75. La jurisprudencia constitucional ha definido el derecho al debido proceso como «el conjunto de garantías previstas en el ordenamiento jurídico, a través de las cuales se busca la protección del individuo incurso en una actuación judicial o administrativa, para que durante su trámite se respeten sus derechos y se logre la aplicación correcta de la justicia»[50].

76. Algunas de las garantías que componen el debido proceso son la «legalidad, juez natural o legal, favorabilidad, presunción de inocencia, derecho a la defensa (derecho a la asistencia de un abogado, a presentar y controvertir pruebas, a oponer la nulidad de las obtenidas con violación del debido proceso, y a impugnar la sentencia condenatoria), debido proceso público sin dilaciones injustificadas, y a no ser juzgado dos veces por el mismo hecho»[51]; entre estas también se ha incluido la jurisdicción o libre acceso a la administración de justicia[52]. Esta corporación ha admitido que en ciertas áreas los diferentes amparos en que se manifiesta el debido proceso pueden aplicar con una mayor rigurosidad[53].

77. En el siguiente cuadro, se indica, de manera preliminar, el contenido de dichas garantías:

|

Derecho |

Contenido |

|

El derecho a la jurisdicción o al libre acceso a la administración de justicia |

Conlleva los derechos al libre e igualitario acceso a los jueces y autoridades administrativas, a obtener decisiones motivadas, a impugnar las decisiones ante autoridades de jerarquía superior y al cumplimiento de lo decidido en el fallo. |

|

El derecho al juez natural |

El juez natural es aquel funcionario con capacidad o aptitud legal para ejercer jurisdicción en determinado proceso o actuación, de acuerdo con la naturaleza de los hechos, la calidad de las personas y la división del trabajo establecida por la Constitución y la ley[54]. |

|

El derecho a la defensa |

Se entiende como el empleo de todos los medios legítimos y adecuados para ser oído y obtener una decisión favorable. De este derecho hacen parte el derecho al tiempo y a los medios adecuados para la preparación de la defensa; los derechos a la asistencia de un abogado cuando sea necesario, a la igualdad ante la ley procesal, a la buena fe y a la lealtad de todas las demás personas que intervienen en el proceso. |

|

El derecho a un proceso público |

Pretende garantizar el desarrollo del proceso o actuación dentro de un tiempo razonable, lo cual exige que estos no se vean sometidos a dilaciones injustificadas o inexplicables. |

|

Principio de legalidad o formas propias de cada juicio |

No existe facultad, función o acto que puedan desarrollar los servidores públicos que no esté prescrito, definido o establecido en forma expresa, clara y precisa en la ley. Los servidores públicos, como los jueces, siempre deben sujetarse a lo prescrito por la ley, la Constitución y demás normas o reglas jurídicas. |

|

Non bis in idem |

Pretende asegurar que los conflictos sociales que involucran consecuencias de tipo sancionatorio no se prolonguen de manera indefinida, además de evitar que un mismo asunto obtenga más de una respuesta de diferentes autoridades judiciales, en procesos que tengan identidad de sujeto, objeto y causa, siendo su finalidad última la de racionalizar el ejercicio del poder sancionatorio en general y, especialmente, del poder punitivo. |

78. El quebrantamiento de cualquiera de estas garantías constituye una violación al derecho fundamental del debido proceso. Por tal motivo, su desconocimiento en el servicio público de administración de justicia supone la violación de los artículos 29, 228 y 229 superiores.

(ii) El debido proceso en un sistema jurisdiccional que utilice razonablemente IA

79. Ahora, en cuanto al tema analizado, se tiene que los avances tecnológicos en materia de IA han tenido un impacto global complejo que ha irradiado cada ámbito de la vida humana, sin que la práctica jurídica sea una excepción y, dentro de ella, el sistema judicial. En efecto, la proliferación de sistemas de IA y su aplicación en escenarios judiciales, tanto en el trámite como en lo sustancial, dan paso progresivo a un nuevo paradigma en el servicio público de administración de justicia. De allí la necesidad de evaluar las condiciones para que la implementación de estas nuevas tecnologías en la Rama Judicial pueda llevarse a cabo con respeto de los derechos fundamentales, entre ellos el debido proceso.

80. En ese orden de ideas, las garantías que componen el derecho fundamental mencionado son uno de los principales derroteros para estudiar los sistemas de IA que pretendan utilizarse en un sistema jurisdiccional. Aunque el debido proceso está integrado por un amplio abanico de garantías, no todas tienen la misma relevancia en el análisis de tal materia. Los aspectos problemáticos asociados a estas tecnologías emergentes hacen que algunas de ellas puedan ser más útiles para aprovechar sus ventajas y controlar los riesgos de su implementación en la Rama Judicial.

81. De manera particular esta Sala de Revisión destaca, como componentes del debido proceso que pueden verse trasgredidos por el uso de IA, (i) la garantía del juez natural, (ii) la garantía de la motivación de las decisiones judiciales y (iii) la garantía del debido proceso probatorio, las cuales se estudiarán en esta decisión, pero antes de ello explicará brevemente en qué consiste un sistema de inteligencia artificial IA y los aspectos básicos acerca de su funcionamiento.

(iii) Sistemas de IA. Concepto y aspectos básicos acerca de su funcionamiento

82. La búsqueda de una definición sobre un sistema de IA debe tener como premisa que se trata de un concepto innovador y cambiante debido a la constante y rápida evolución de este fenómeno tecnológico. No es lo mismo hablar de IA en 1950[55], cuando era una idea apenas emergente a la que ni siquiera se le había dado tal denominación, que hablar de su significado en los días actuales, cuando este ámbito científico agrupa tecnologías que, a través del procesamiento masivo de datos, tienen incluso la capacidad de permitir el aprendizaje automático para este tipo de herramientas.

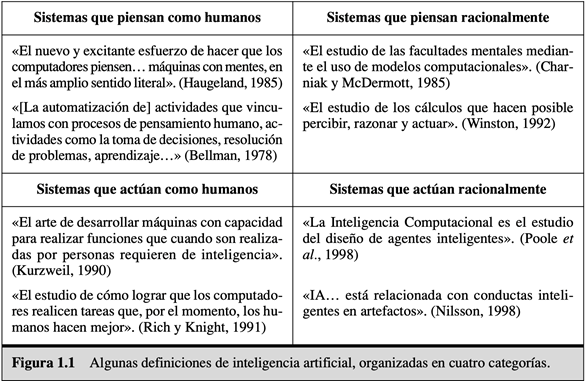

83. Aunque las capacidades de los sistemas de IA son variables, el punto de partida para aproximarse a tal concepto está en cuatro criterios: (i) el razonamiento, (ii) la racionalidad, (iii) la conducta y (iv) la fidelidad en la forma de actuar con los humanos. De allí que un sistema de IA pueda definirse como (i) sistemas que piensan como humanos; (ii) sistemas que piensan racionalmente; (iii) sistemas que actúan como humanos y (iv) sistemas que actúan racionalmente[56]. Con el propósito de comprender cada una de estas concepciones, Russell y Norvig[57] presentan el siguiente cuadro:

84. Conforme con lo anterior, se puede establecer que el razonamiento es «el proceso mental de deducir conclusiones lógicas y hacer predicciones a partir de los conocimientos, hechos y creencias disponibles. O también podemos decir que es una forma de inferir hechos a partir de datos existentes. Es un proceso general de pensar racionalmente, para encontrar conclusiones válidas»[58]. Un ejemplo de razonamiento en inteligencia artificial es su capacidad para utilizar el procesamiento del lenguaje natural. Gracias al razonamiento, la IA puede tomar decisiones lógicas y racionales. De allí que la construcción de una IA simule los canales neurológicos del cerebro humano.

85. La racionalidad, se entiende como aquella habilidad de elegir la mejor acción a realizar con el propósito de alcanzar cierto objetivo, dados ciertos criterios a optimizar y teniendo como base una serie de recursos disponibles. Un sistema de IA consigue ser racional al percibir su entorno a través de sensores que le permiten recoger e interpretar datos, con los cuales puede razonar sobre lo percibido o procesar la información que generan tales datos, para así decidir cuál es la mejor acción por emprender a través de unos actuadores[59]. Una vez ejecutada la acción es posible que se modifique el ambiente, de manera que, la próxima vez, el sistema necesita usar nuevamente sus sensores para poder percibir la información diferente, resultante del ambiente modificado[60].

86. La conducta se enfoca en todas las acciones y comportamientos que los sistemas de IA pueden emitir como una respuesta a su entorno y a los estímulos que reciben, los cuales a su vez pueden variar conforme al modelo de aprendizaje usado por la misma, los datos con los que se ha entrenado el sistema, el entorno para el que se usa la IA y los objetivos para los cuales fue diseñada[61].

87. La fidelidad en la forma de actuar con los humanos hace referencia a la capacidad que tiene el sistema de IA para mantener y transmitir a los usuarios un comportamiento consistente, confiable y predecible en las interacciones que se den. Para lograr esa fidelidad o confianza entre máquina y ser humano, se requiere que la herramienta tecnológica sea precisa, consistente y transparente con la información que emite. Aquí, es en donde varios expertos en el asunto encuadran el tema de la ética de la IA y su estudio[62].

88. Los sistemas de IA tienen tres habilidades básicas principales: (i) percepción, (ii) razonamiento o toma de decisiones y (iii) actuación. Estos son elementos mínimos que definen un sistema racional de IA (rational AI system), una versión más básica en la que hay una modificación del ambiente, pero a lo largo del tiempo el sistema no tiene la capacidad de adaptar su comportamiento para alcanzar sus objetivos de una mejor manera. Su evolución y modernización ha derivado en lo que se conoce como sistemas racionales de aprendizaje de IA (learning rational AI system). A diferencia de los primeros enunciados, después de tomar acción, estos tienen la capacidad de evaluar, por medio de la percepción, el nuevo estado del ambiente con el fin de determinar qué tan exitosa fue la acción y, entonces, adaptar sus reglas de razonamiento y métodos de toma de decisión.

89. Los constantes y rápidos avances en la materia hacen que, de manera continua, los expertos en esta disciplina científica realicen ajustes y actualizaciones al concepto de IA. Aunque no exista una definición única y universalmente aceptada, en términos simples, puede afirmarse que se trata de sistemas que tienen la capacidad para analizar el ambiente o entorno en el que están inmersos y así emprender acciones, con algún grado de autonomía, a efectos de alcanzar objetivos específicos. En 2019, la Comisión Europea[63] definió las herramientas de IA como:

[S]istemas de software (y posiblemente también de hardware) diseñados por humanos que, dado un objetivo complejo, actúan en la dimensión física o digital percibiendo su entorno mediante la adquisición de datos, interpretando los datos recogidos -sean estos estructurados o no- razonando sobre el conocimiento o procesando la información derivada de estos datos y decidiendo la(s) mejor(es) acción(es) a tomar para alcanzar un determinado objetivo. Los sistemas de IA pueden utilizar reglas simbólicas o aprender un modelo numérico y también pueden adaptar su comportamiento analizando cómo se ve afectado el entorno por sus acciones anteriores[64]

90. Un concepto más reciente es el de la Organización para la Cooperación y el Desarrollo Económicos (OCDE) que, el 5 de marzo de 2024, publicó el memorando explicativo n.º 8 sobre la definición actualizada de la OCDE de un sistema de IA, con la que efectuó cambios al concepto que había adoptado en 2019, para señalar que:

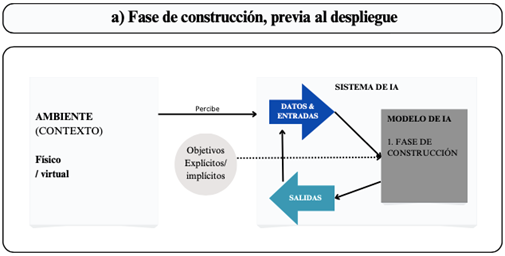

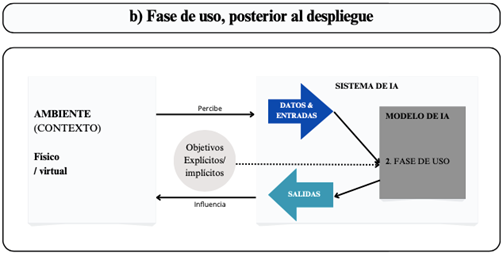

Un sistema de IA es un sistema basado en una máquina que, ya sea para alcanzar objetivos explícitos o implícitos, infiere -a partir de la entrada que recibe- cómo generar salidas, tales como predicciones, contenidos, recomendaciones o decisiones, las cuales pueden influir en entornos físicos o virtuales. Los diferentes sistemas de IA varían en sus niveles de autonomía y capacidad de adaptación después de su implementación[65]

91. Dicho lo anterior, es importante precisar que los sistemas de IA tienen un ciclo de vida que se compone de cuatro fases: (i) el diseño de datos y modelos, que incluye planificación, diseño, toma y procesamiento de datos, así como construcción e interpretación de modelos; (ii) la verificación y validación del sistema; (iii) el despliegue; y, por último, (iv) su funcionamiento y supervisión.

92. Para explicar el concepto en términos más ilustrativos, la OCDE propone el siguiente gráfico, que representa una visión general simplificada de un sistema de IA:

«Nota: esta figura presenta sólo una posible relación entre las fases de desarrollo y despliegue. En muchos casos, el diseño y el entrenamiento del sistema pueden continuar en usos posteriores. Por ejemplo, quienes despliegan sistemas de IA pueden afinar o entrenar continuamente los modelos durante su funcionamiento, lo que puede influir significativamente en el rendimiento y el comportamiento del sistema»[66].

93. Como puede observarse de los anteriores gráficos, en el entrenamiento de la IA son fundamentales los datos que se le suministren y en su funcionamiento destacan dos elementos esenciales: (i) la autonomía y (ii) la adaptabilidad. El primero alude al grado en el que, después de la delegación de autonomía y automatización de procesos por parte de los seres humanos, el sistema puede aprender o actuar sin la intervención de estos. En efecto, algunos sistemas de IA pueden generar resultados que no están explícitamente descritos en el objetivo del sistema y sin instrucciones específicas de un ser humano. De otro lado, la adaptabilidad se refiere a la capacidad del sistema para modificar su comportamiento por medio de la interacción directa con datos de entrada, antes o después de la implementación[67].

94. La adaptabilidad se presenta principalmente en sistemas de IA basados en técnicas de aprendizaje automático (machine learning). Se trata de un tipo de aprendizaje de la IA en el que las máquinas hacen uso de enfoques estadísticos a fin de aprender de datos históricos y patrones para, de esta forma, predecir situaciones nuevas. Con ello logran resolver problemas que no pueden especificarse con exactitud o cuyo método de resolución no puede plantearse en reglas de razonamiento simbólico. El proceso consistente en mejorar el rendimiento de un sistema mediante técnicas de aprendizaje automático se conoce como entrenamiento. Los sistemas de IA pueden entrenarse una vez, periódicamente o de manera continua[68].

95. Una de las ramas de la IA que aparece con el aprendizaje automático es la IA generativa. Se trata de un sistema de IA basado en machine learning que tiene la capacidad de generar contenido sintético como texto, imágenes y sonido, a partir de un comando que contiene una premisa. Estos modelos de IA pueden producir contenidos completamente novedosos, que no han sido ingresados como entrada en el proceso de entrenamiento. Por ejemplo, si el modelo ha sido entrenado en una serie de datos de imágenes de paisajes, tendrá la capacidad de generar imágenes de paisajes nuevos y únicos.

96. Una forma de IA generativa es el procesamiento de lenguaje natural (Large Language Models -en adelante LLM-, o Sistemas Predictivos de Lenguaje), que otorga a los ordenadores la capacidad de comprender textos y palabras de manera similar a los seres humanos, para lo cual se combina la lingüística computacional, que se basa en reglas de lenguaje humano, con modelos estadísticos[69].

97. Visto lo anterior, es posible señalar que, hoy en día, la IA se diferencia de tecnologías de la información anteriores, principalmente, por dos características. En primer lugar, estas nuevas tecnologías son capaces de aprender, es decir, pueden identificar patrones y descubrir nueva información sin la asistencia de un humano, así como predecir eventos futuros. En segundo lugar, la IA puede actuar con cierto grado de autonomía. Esto es, puede tomar, por sí sola, decisiones que no están preprogramadas. En teoría, un nivel más alto de autonomía implicaría la capacidad de determinar estrategias óptimas para completar ciertas tareas e incluso determinar objetivos[70].

98. Estas habilidades son el resultado de la imitación de las redes neuronales humanas. En otras palabras, la IA emula la estructura del cerebro humano. De este modo, las herramientas de IA aprenden sobre la base de grandes volúmenes de datos y encuentran soluciones a problemas que no sólo no se conocen, sino que en muchos casos no se podrían visualizar. Muchas veces estos sistemas descubren atributos o representaciones intermedias que le permiten realizar tareas. Otras veces encuentran una forma particular de hacerlo que no se le habría ocurrido a un humano. Y otras tantas, estos circuitos, que se han consolidado en el entrenamiento para resolver un problema, les permiten resolver otros inesperados, sin que quien desarrolló esa red neuronal pudiese preverlo de antemano[71].

99. De manera especial, las herramientas de IA generativas son una clase emergente de algoritmos de inteligencia capaces de producir contenido novedoso, en diversos formatos como texto, audio, video, imágenes y código, según las indicaciones del usuario. El aprendizaje, los conjuntos de datos masivos y los aumentos sustanciales en la potencia informática han impulsado tales herramientas para el desempeño a nivel humano en puntos de referencia académicos y profesionales[72].

100. Según el último informe del índice de inteligencia artificial de 2023 de la Universidad de Stanford[73], Estados Unidos ha mantenido su liderazgo en la inversión en inteligencia artificial (IA). Durante el año 2022, Estados Unidos encabezó el mundo en términos del monto total invertido en IA por parte del sector privado. La cifra alcanzó los $47.4 mil millones, lo que representa aproximadamente 3.5 veces la inversión realizada en el siguiente país con mayor inversión, China, que llegó a los $13.4 mil millones. Además, Estados Unidos continúa liderando en cuanto al número total de empresas de IA que han recibido financiamiento recientemente, superando en 1.9 veces a la Unión Europea y al Reino Unido combinados, y en 3.4 veces a China.

101. Durante el mismo año, el sector de la salud y la atención médica recibió la mayor cantidad de inversión en IA, alcanzando los $6.1 mil millones; seguido por la gestión de datos, procesamiento y nube, con $5.9 mil millones; y Fintech, con $5.5 mil millones. Las empresas están implementando la IA de diversas maneras. Las capacidades de IA más comúnmente adoptadas por las empresas incluyen la automatización de procesos robóticos (39%), la visión por computadora (34%), la comprensión de texto en lenguaje natural (33%) y los agentes virtuales (33%). Además, el caso de uso más frecuentemente adoptado en 2022 fue la optimización de operaciones de servicio (24%), seguido por la creación de nuevos productos basados en IA (20%), la segmentación de clientes (19%), el análisis de servicio al cliente (19%) y los nuevos mejoramientos basados en IA de productos (19%).

102. En relación con América Latina, según el índice latinoamericano de inteligencia artificial de 2023 del Centro Nacional de Inteligencia Artificial[74], su adopción[75] alcanzó un promedio de 38,27. En esta oportunidad, Chile encabezó este aspecto con un puntaje de 84,11, seguido por Uruguay y Argentina, que registraron 69,43 y 53,96, respectivamente. Colombia, por su parte, obtuvo un porcentaje de 31,0.

103. Es notable el impacto que la IA tiene en diferentes sectores de la sociedad y cómo puede contribuir en la mejora de las condiciones sociales y en la materialización de los derechos fundamentales.

104. En ese sentido, es importante tener presente la diferencia entre derecho informático e informática jurídica o actualmente legal tech. Mientras el primero hace alusión a las normas que regulan la incorporación de la informática en la vida social; el segundo, tema de análisis en esta sentencia, consiste en la aplicación de métodos informáticos en el campo del derecho[76].

105. En este caso particular, se trató de la aplicación de ChatGPT por parte del Juzgado del Circuito en la sentencia de tutela de segunda instancia del 30 de enero de 2023. ChatGPT es una de las tantas IA generativas[77] que se basa en un modelo de lenguaje de gran tamaño (LLM). Fue desarrollado por la empresa OpenAI[78]. Este sistema está «basado en la arquitectura GPT (Generative Pre-trained Transformer). GPT se refiere a un tipo de modelo de aprendizaje automático que ha sido entrenado en grandes cantidades de datos de texto para generar respuestas coherentes y relevantes en función de las entradas que recibe. Esto no quiere decir que la información sea real, fiable ni verificable; pues los LLM se basan en predicciones de texto coherentes»[79] [negrillas fuera del texto original].

106. En el informe que presentó dentro del presente trámite de revisión, OpenAI explicó que ChatGPT es un modelo de IA que produce texto conversacional. Los usuarios interactúan con la herramienta a través de una interfaz de chat en línea en la que pueden hacer una petición, instrucción o pregunta y esta, a su turno, escribe una respuesta, con base en lo que ha «aprendido» de las bases de datos con las que se ha entrenado a la herramienta. Así, en esencia, ChatGPT es un medio creativo o, más específicamente, una herramienta de producción de contenido a partir de instrucciones.

107. La herramienta se hizo pública el 30 de noviembre de 2022. Para entonces, ChatGPT se basaba en un modelo de IA llamado GPT-3.5, que actualmente sigue funcionando en forma gratuita, pero con la limitante de que su información está actualizada hasta enero de 2022. Existe un segundo modelo más reciente denominado GPT-4, el cual, inicialmente, solo podía ser utilizado por quienes pagaran su suscripción, pero desde el pasado 13 de mayo se anunció que estaría habilitado de manera gratuita, prometiéndose que sería una herramienta con mejoras en la capacidad de texto, visión y audio y más fácil de usar[80].

108. Sobre la forma en que OpenAI desarrolla sus modelos de IA, explicó que ChatGPT:

[A]naliza un gran número de palabras para poder predecir la palabra más probable para continuar una frase, y cada una de las palabras siguientes. Hay un gran número de combinaciones posibles de palabras que pueden aparecer a continuación en cualquier frase. Para predecir con fiabilidad una palabra que tenga sentido en una situación determinada, un modelo de IA debe comprender cómo encajan las palabras. Esencialmente, un modelo tiene que aprender todos los elementos del lenguaje: vocabulario, gramática, estructura de las frases e incluso razonamiento básico. Este es el objetivo del proceso de entrenamiento de la IA.

El proceso de entrenamiento consiste en dar al modelo una gran cantidad de frases para que las “estudie”. El modelo revisa cada frase palabra por palabra e intenta predecir la siguiente palabra de cada frase. Cuando comienza el proceso de entrenamiento, el modelo no sabe cómo predecir palabras y simplemente emite palabras aleatorias. Con suficientes intentos y frases, el modelo aprende con el tiempo mejores palabras que se ajustan a cada frase […]